一、AI 模型调用时代的三大挑战:协同难、延迟高、开销大

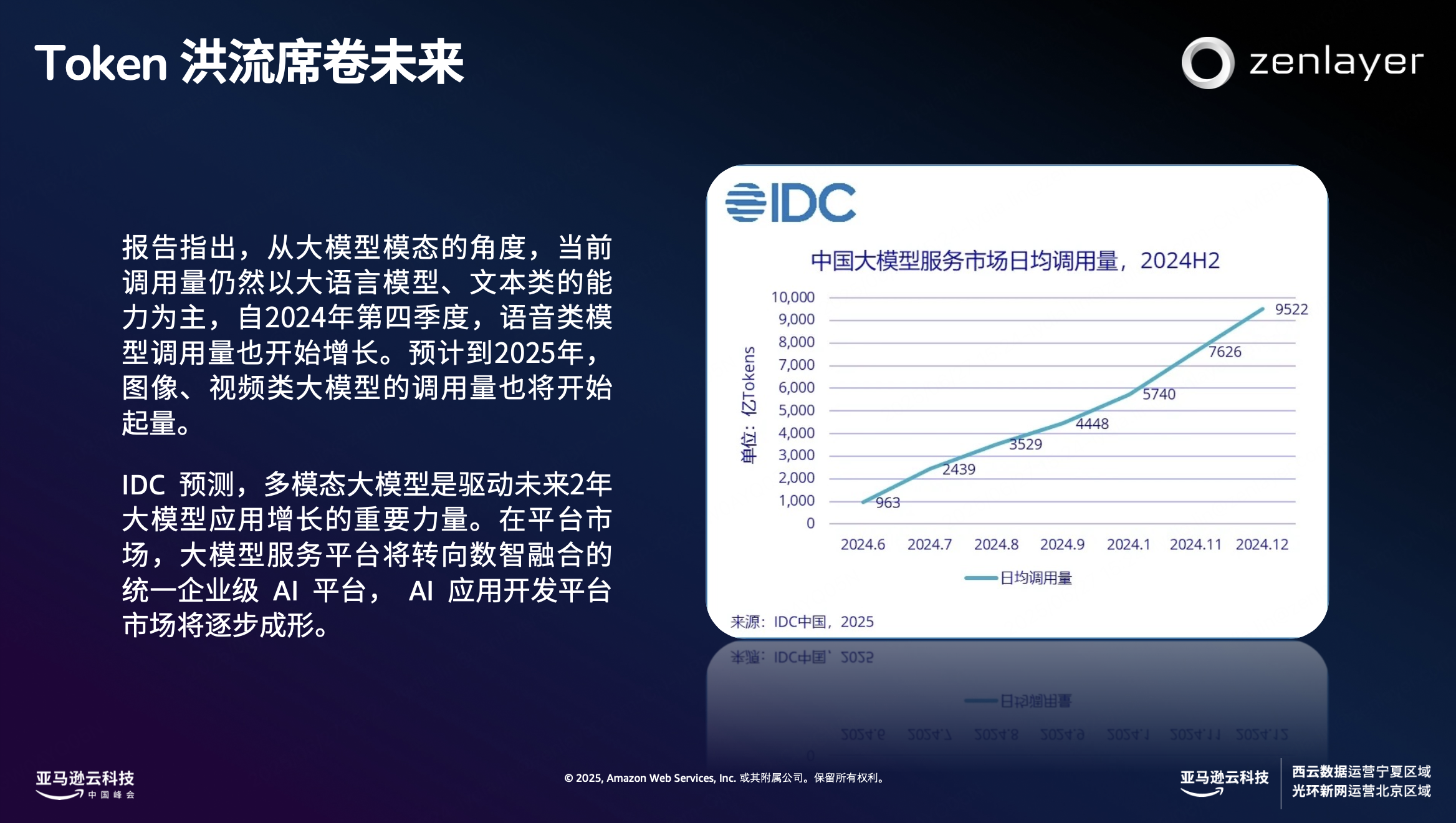

当前大模型的核心发展趋势存在三个关键方向:多模态融合、多模型协同以及 RAG 架构普及。

IDC 预测,多模态大模型是驱动未来 2 年大模型应用增长的重要力量。在平台市场,大模型服务平台将转向数智融合的统一企业级 AI 平台,多模型协同逐渐成为 AI 应用主流场景。而为了降低 AI 幻觉、提升数据输出的准确度,RAG 架构逐渐成为 AI 部署的标配。

在这一趋势下,AI 的能力虽然得到提升,却以复杂度、成本与延迟为代价,企业部署 AI 时挑战重重:

1. 模型接入与管理困境

• 多模型接入复杂:不同模型的 API 接口、数据格式、调用方式各异,开发和集成的工作量成本巨大。

• Token 成本激增:据估算,一家中型企业每月调用大模型的 Token 数量可达千万级,仅Token 调用曾本就可能高达数万美元。

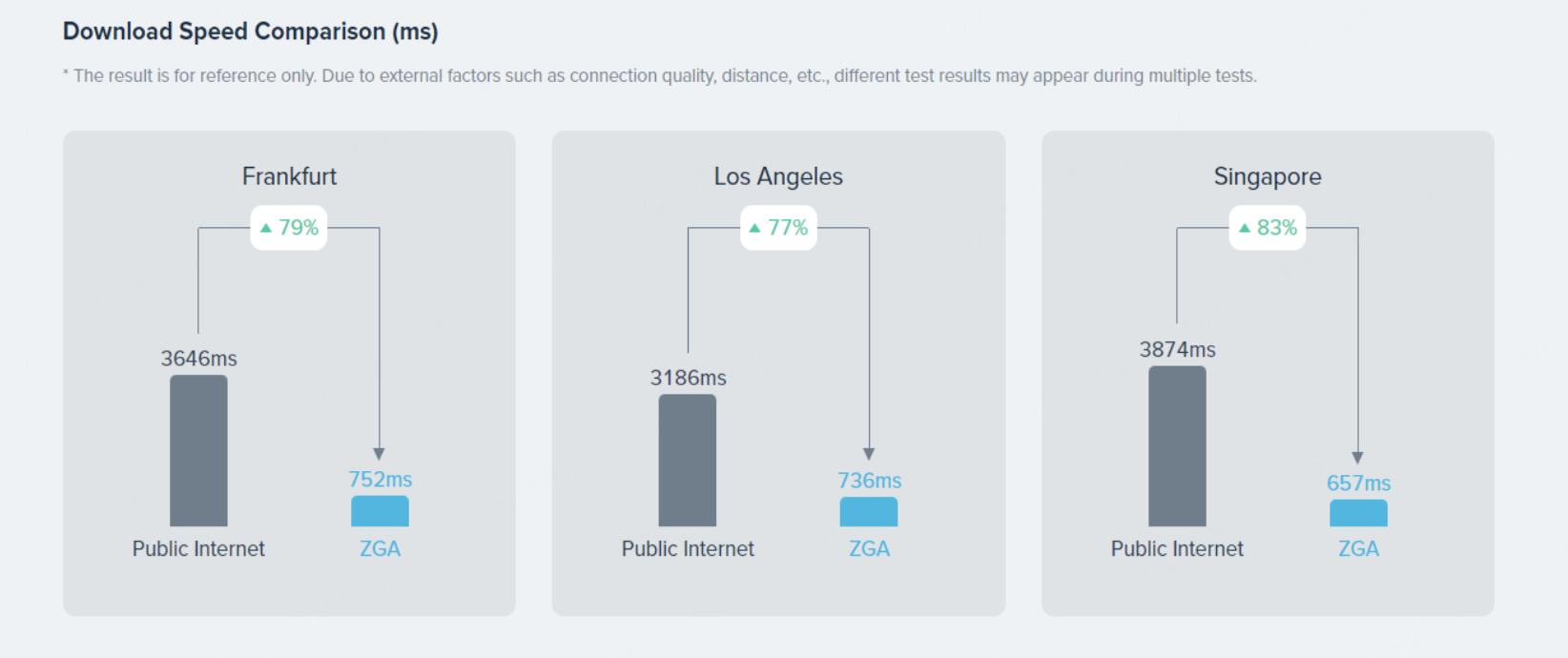

• 跨区域延迟与卡顿:数据传输延迟严重,例如从中国调用美国的 OpenAI 模型,平均延迟高达 200ms 以上,网络不稳定将进一步引发业务中断风险。

• 系统集成与分散计费:需解决数据安全、权限管理等集成难题,且需对接多个服务商计费系统,管理负担沉重。

2. RAG 场景的叠加挑战

• 链路更长,延迟增加:RAG 架构的多跳通信显著延长响应时间

• Token 消耗倍增:需要拼接大量上下文,Token 消耗通常是普通对话的 3-5 倍甚至更高

郭天铭指出,企业必须具备“就近处理 + 高质量传输 + 多模型协同”的能力,方能破解上述难题。

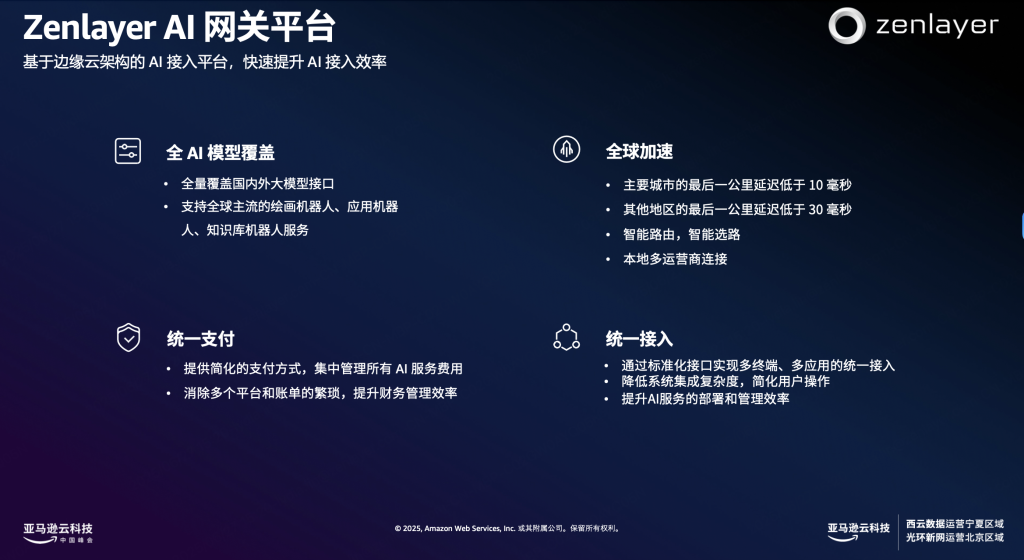

二、Zenlayer AI Gateway:让 AI 模型调用更丝滑

针对行业痛点,Zenlayer 创新推 Zenlayer AI Gateway 解决方案,通过整合全球超连接网络与 Zenlayer AI Gateway 平台,为企业打造端到端的 AI 部署优化方案。该方案已助力某头部社交平台实现开发运维成本降低 20%。

3. 全球网络加速

📢 Zenlayer 产品现已上线 AWS Marketplace,我们提供 ZGA、SDN Direct Connect、IPT 等服务,可进行 7 天免费测试,并可实现自助开通和集中化计费管理。