> 分布式推理平台

全球规模化落地,释放实时 AI 潜能

助力您的 AI 应用在全球范围内即时部署、连接并规模化落地,借助智能编排、内置框架与实时监控,大幅简化部署流程,实现性能、效率与成本三重优化。

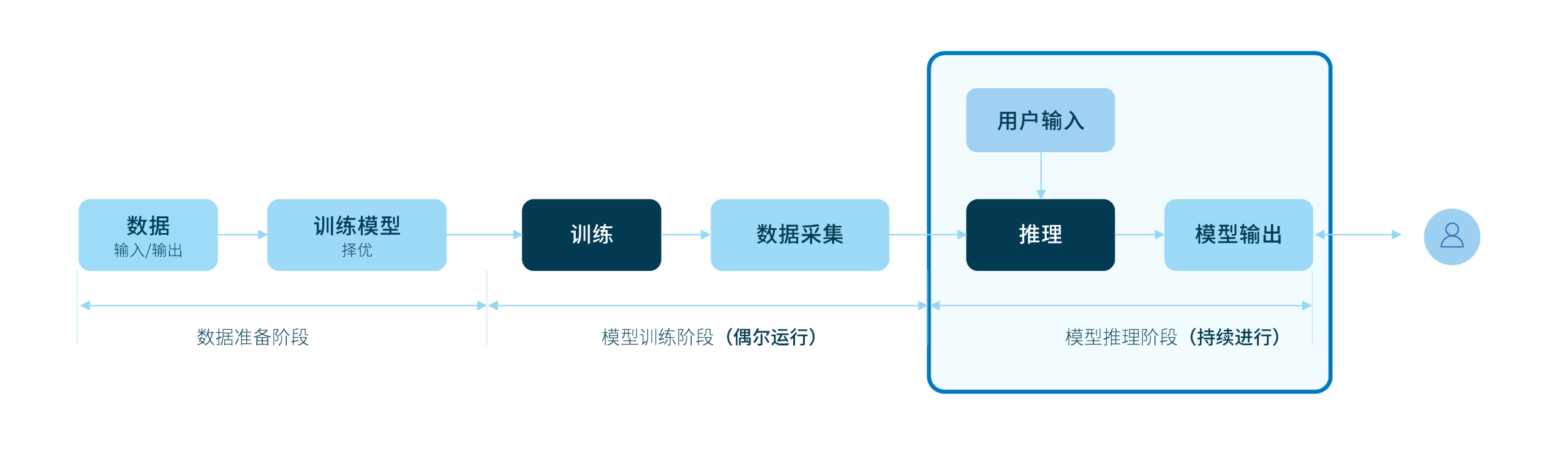

推理是保障 AI 应用性能与效率的核心环节

推理环节持续进行

AI 与用户的每次交互都会触发推理,Agentic AI 使推理从单次响应变为多轮思考,显著增加计算复杂度。

占据模型大量成本

对多数模型而言,推理可能占模型全生命周期成本的 80–90%,持续的推理导致计算需求激增,进而影响整体支出。

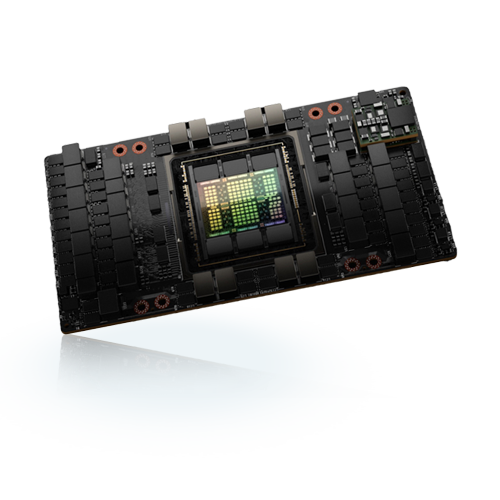

为智能而生的 GPU 算力

推理的关键,在于平衡性能、成本与用户体验。想要在全球范围内实现高可靠的规模化运行,算力必须与模型的升级、实时需求的激增精准同频。

依托 Zenlayer 优质的 GPU 基础设施,技术团队可实现模型的快速部署与高效运维,为全球用户提供稳定的智算性能。

性能拓展,随心掌握

选用顶级 GPU,经济高效地升级您的 AI 技术栈

NVIDIA RTX 4090

- 快速原型设计与模型开发

- 支持生成式图像、视频及 3D 内容创作

- 经济高效的边缘推理部署

NVIDIA H100

- 大模型高速推理

- 大语言模型与多模态 AI 加速

- 支撑生产级 AI 工作负载实现吞吐量峰值输出

NVIDIA H200

- 面向 LLM 及嵌入向量的顶级推理服务

- 支持数十亿参数生成式模型运行

- 适配分布式 AI 的全球规模化部署

随时随地,

尽享高速推理

预置 AI 解决方案

- 预置 Ollama, Stable Diffusion, and Llama 等主流模型工具

- 可视化 Web UI 界面

灵活选择

- 直连原生 OS 及框架,无需额外适配

充足网络容量

- 跨区域专用连接

- 高网络容量

- 高性价比的 IP 传输

应用场景

AI 和机器学习

加速神经网络等 AI/ML 模型训练,释放智能算力潜能

高性能算力

充足计算吞吐量加持,让大规模计算轻松落地

游戏流媒体与虚拟现实

无需投入昂贵硬件成本,亦可实现高质量视觉效果与沉浸式体验

> 成功案例

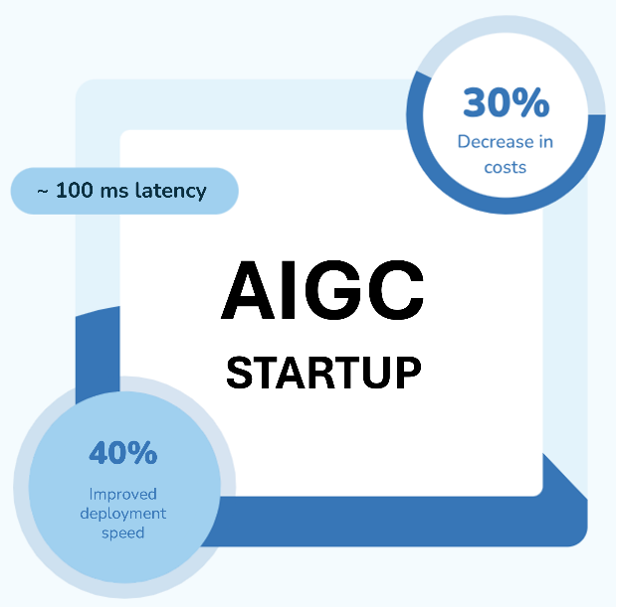

AIGC 初创公司通过 Zenlayer 提升 40% 部署效率

一家高速成长的 AI 生成式视频初创公司,通过Zenlayer 分布式推理平台提升用户体验,降低基础设施成本。

该公司借助弹性 GPU 集群、智能推理调度器以及调优运行环境,实现业务按需扩展,大幅提升计算效率。在 Zenlayer 全球专用骨干网与模型仓库的协同助力下,这家初创公司为全球用户带来更流畅的 AI 实时体验。

核心成果:

• 降低延迟至 100 ms,实现模型快速响应

• 通过高效的 GPU 运用,降低 30% 基础设施成本

• 通过版本管理/热加载功能,提升 40% 部署效率

更多资源

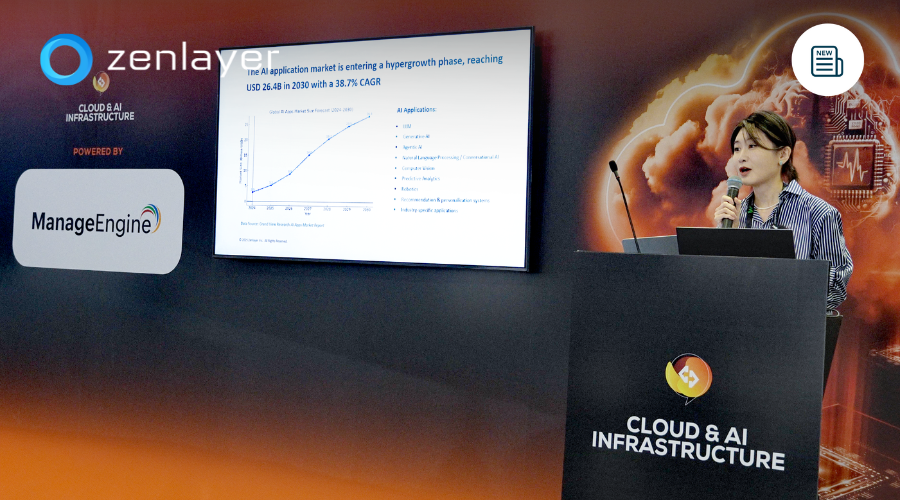

AiCon 圆桌精华|把握数字基建,AI 时代企业如何出海更高效?

AI 狂飙时代,基建实力决定终端效能。12 月 19-20 日,Zenlayer 联袂 Digital Realty 现身 InfoQ AiCon 全球人工智能开发与应用大会,与头部 AI 应用领域的技术专家、产品精英共聚一堂,共话 AI 前沿应用与未来风向。

化解 AI 泄密风险,Zenlayer 携手 Palo Alto 重塑安全访问解决方案

作为 Palo Alto Networks 核心技术合作伙伴,Zenlayer 受邀参与了此次活动,不仅在现场展示最新 AI 基础设施进展,更通过主题演讲解锁了 AI 时代企业安全组网的全新解决方案。

Zenlayer 与 AIDC 服务提供商 Yovole International 达成战略合作,升级亚太 AI 数字基建

未来双方将聚焦亚太地区数字基础设施升级,围绕 AIDC 基础设施协作、网络互联互通、服务整合等方面展开深度合作,共同打造高效协同的数字基础设施服务生态。

聚力 AI・共筑安全:Zenlayer 亮相 Fortinet Partner Sync 2025 北亚峰会

这一合作成功融合了 Zenlayer 低延迟、高稳定的全球网络与 Fortinet 安全驱动的统一 SASE 能力,为企业提供了连接性与安全性兼顾的 IT 基础设施。

Zenlayer AI 网关详解|一网畅连大模型,加速智能应用开发

在 AI 应用开发中,传统 API 网关在处理高并发、低延迟需求以及多模型复杂管理时往往力不从心。为此,Zenlayer 推出 AI 网关(Zenlayer AI Gateway)——一款云原生网关服务,集 API 管理、智能路由、流量优化、多模型编排与性能监控于一体。

新加坡科技周专访|以超连接云驱动 AI 分布式推理革新

Sisi 指出,当前 AI 热度持续攀升,带动大规模基建投资,亚太地区已成为核心战略市场。Zenlayer 深耕于此,为全球 AI 部署打造核心基础架构。本次新加坡科技周更是绝佳契机:既能分享最新产品动态,与客户及伙伴探讨新应用场景、探索行业未来方向,更能联动行业生态圈,为亚太蓬勃的 AI 发展注入动力。

Zenlayer 推出分布式推理平台,加速 AI 创新全球落地

推理是 AI 兑现实际价值的核心环节,但其面临的效率瓶颈与性能挑战正日益突出。通过将 Zenlayer 超连接的基础设施与分布式推理技术相结合,我们将支持企业和 AI 应用提供商实现模型在全球范围内即时、经济且规模化的部署,最终助力其在全球市场快速落地 AI 服务。

Zenlayer 荣膺阿里云首批云网络产品能力认证伙伴,联合打造硬核云连接方案

在云栖大会产品生态峰会上,Zenlayer Cloud Networking 产品凭借卓越的产品服务能力,获得阿里云首批颁发的云网络产品能力认证伙伴。此次认证不仅标志着 Zenlayer 云网络产品的服务能力已达到行业领先标准,更意味着 Zenlayer 与阿里云的生态合作达到新阶段。

Zenlayer 亮相 2025 云栖大会,加速 Token 全球高效流转

要实现 Token 在全球的高效流转:首要任务是构建覆盖全球多数国家的优质专用骨干网,确保每条线路稳定、可控,并与各大公有云建立高速直连通道

DCA 圆桌回顾|AI 应用大爆发,AIDC 生态如何协同升级?

AI 应用热潮下,全球市场分化加剧,生态协同效率已成为核心竞争力。唯有数字基础设施行业全链条深度共振,才能突破单点局限,让技术从“可用”变“好用”,共同推动数字经济迈向更智能的未来。

Zenlayer 闪耀 GTC 2025 全球流量大会:全球互联,智驭出海

在此次大会现场,Zenlayer 联合 Equinix 推出赋能 AI 时代的全球基础设施解决方案,助力企业在出海过程中实现互联互通。

柔佛成东南亚数据中心新晋宝地,中国企业如何借力柔新特区实现出海高效部署?

目前,柔佛州共有 22 座数据中心在运营,另有 8 座在建。这一发展势头背后,柔佛究竟有何魔力吸引科技巨头抢滩?

AI 时代的边缘动力:Zenlayer 再入选“中国边缘计算企业 20 强”

此次评选聚焦边缘 AI 与大模型融合、AI 边缘创新案例等边缘计算领域的技术革新,标志着 Zenlayer 在 AI 与边缘计算深度融合趋势下的核心实力再获行业权威认可。

从 ChatGPT 到 DeepSeek,看 AI 新范式下的网络革命

我们仍处于 AI 革命的初期阶段,但 Zenlayer 的经验已经证明,AI 对高带宽和性能的需求正在成为 IT 基础设施和网络架构设计的重要转折点。

Zenlayer 携手 Global Switch,为亚太地区联合打造前沿 AI 基础设施解决方案

Zenlayer 最新升级的 Fabric for AI 广泛连接亚洲各大 AI 算力集群;通过将我们的网络与 Global Switch 先进的数据中心相结合,我们提供了一站式的解决方案,简化了 AI 部署流程,让企业能够专注于创新,引领行业发展。